虽然 ChatGPT 等等这些网页工具都非常方便,但是很多时候都是在远程服务器上开发,经常想着如果能在命令行里快速调用一个 LLM 来做一些 PDF 的 summary ,或者 code-review 之类的工作,可以提升一定的效率,因此这个周末做了一个小工具。 一方面它可以把一些 workflow 固定下来打包,这样可以之后快速重用;另一方面也可以使用一些别人提前制作好的包。

使用方法:

# 安装一个 `vibe`的 executable

pip install v-agents

# 安装 docqa 的包

vibe install docqa

# QA to remote files, this package will download and parse PDF, then feed into LLM

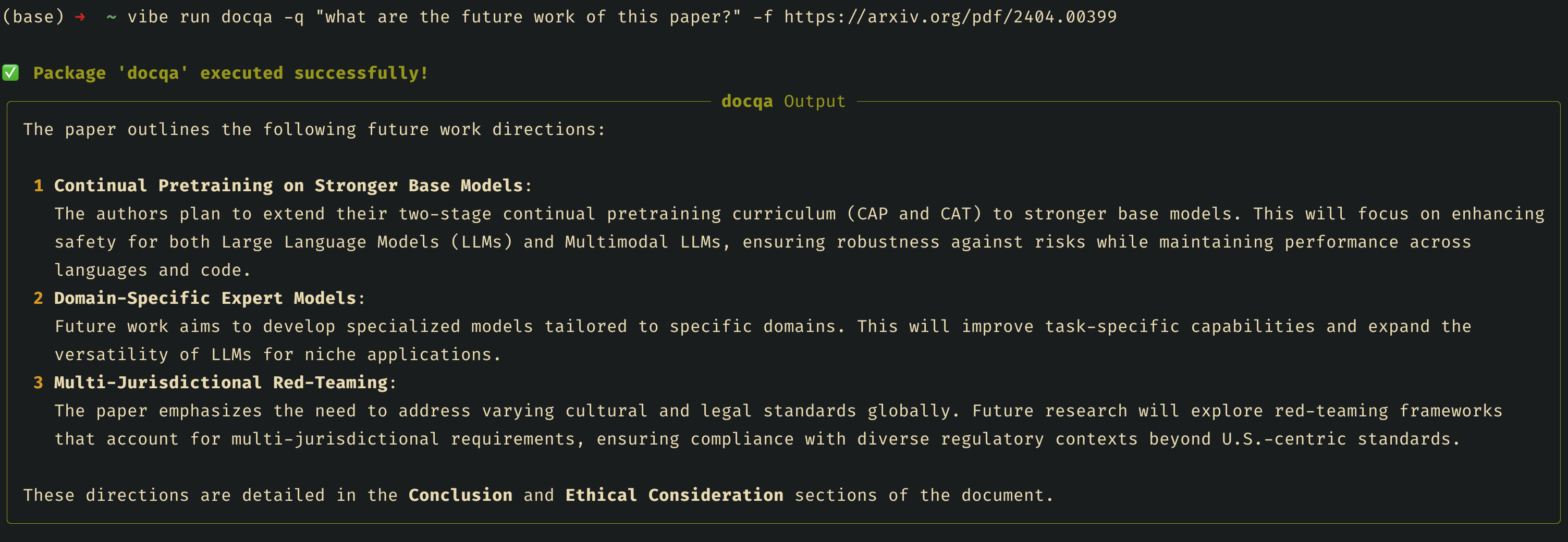

vibe run docqa -q "what are the future work of this paper?" -f https://arxiv.org/pdf/2404.00399

如果你在一个 git installed 的文件夹里,也可以:

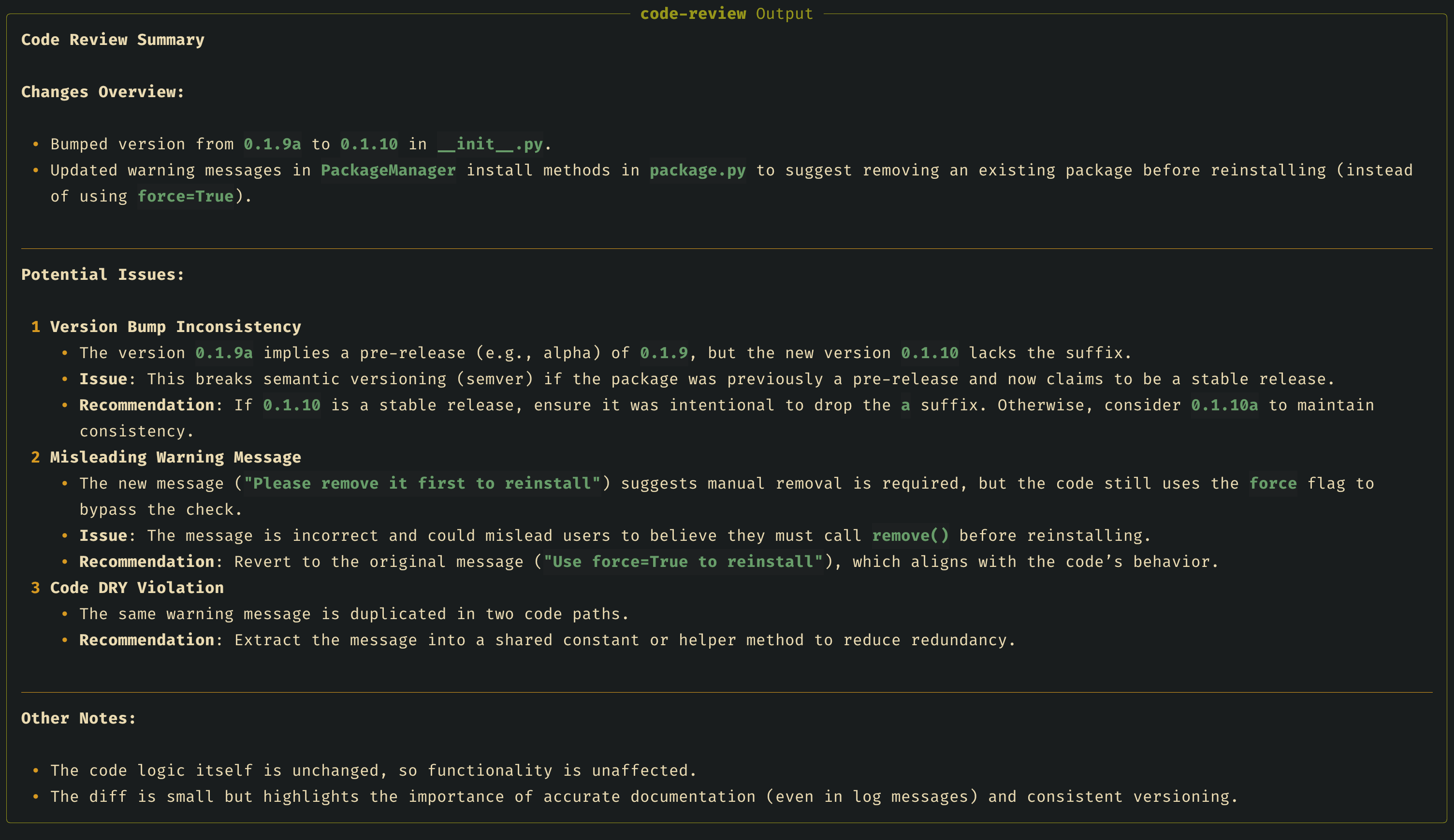

vibe install code-review

vibe run code-review

目前这个会使用一个远程的 LLM ,运行在一个去中心的 LLM Serving 系统上。也可以通过环境变量使用任意 LLM 。

GitHub: https://github.com/researchcomputer/vagents

两个包的例子: https://github.com/vagents-ai/packages

欢迎来Discord讨论和分享!

2 条回复 • 2025-08-17 11:52:20 +08:00

1

ferock PRO 你说的是 gemini cli ?

|